Wie zuverlässig ist ein Fingerabdruck? Die Wissenschaft, die Technik, die Grenzen, und was in keinem Gerichtssaal der Welt klar genug gesagt wird

Die Frage, die mir über dreieinhalb Jahrzehnte Sachverständigentätigkeit häufiger gestellt wurde als fast jede andere, ist auf den ersten Blick auch die einfachste: Wie zuverlässig ist ein Fingerabdruck? Die Einfachheit trügt. Hinter ihr verbirgt sich ein Geflecht aus Embryologie, Statistik, Bildverarbeitung, Kognitionswissenschaft und forensischer Erkenntnistheorie, das die meisten Einführungen in das Thema zu einer Gewissheit glätten, die das vorhandene Beweismaterial nicht vollständig stützt. Dieser Beitrag, der auf dem wissenschaftlichen Aufsatz aufbaut, den ich gemeinsam mit Dr. Maria-Louise Morgott durch das International Institute of Forensic Expertise veröffentlicht habe, versucht der Frage die Behandlung zu geben, die sie tatsächlich verdient: ausgehend von den biologischen Grundlagen der Einzigartigkeit des Fingerabdrucks, über die technischen Prozesse der Sicherung und des Vergleichs latenter Spuren, hinein in den statistischen Rahmen, der darüber entscheidet, wie Gewissheit ausgedrückt werden sollte und wie nicht, und schließlich zu den Fragen kognitiver Verzerrung und gerichtlicher Kommunikation, an denen sich entscheidet, ob diese Disziplin der Gerechtigkeit dient oder ihr lediglich den Anschein verleiht.

Eines sei vorab klar gesagt: Fingerabdruckbeweise sind real, ihre biologischen Grundlagen sind solide, und korrekt angewendet bleibt die Daktyloskopie eines der mächtigsten Identifikationswerkzeuge, die der forensischen Ermittlung zur Verfügung stehen. Das Argument dieses Beitrags ist nicht, dass Fingerabdrücke unzuverlässig sind. Das Argument ist, dass die Kluft zwischen dem, was Fingerabdruckbeweise legitim beanspruchen können, und dem, was von ihnen in Gerichtssälen routinemäßig behauptet wird, breit genug ist, um unschuldige Menschen in Gefängnisse zu bringen und um zu verhindern, dass diese Kluft sich schnell genug schließt.

Zuerst die Biologie: Warum Fingerabdrücke überhaupt einzigartig sind

Die Unterschiedlichkeit von Fingerabdruckmustern ist keine kriminaltechnische Konvention und keine statistische Näherung. Sie ist eine biologische Tatsache, die in der Entwicklungsmechanik des menschlichen Fetus verwurzelt ist, und wer sie auf dieser Ebene versteht, versteht auch, warum Fingerabdruckbeweise stark sind und wo ihre tatsächlichen Grenzen liegen.

Die Reibungsleistenhaut, jene erhabene dermale Struktur, die Fingerabdruckmuster erzeugt, beginnt sich zwischen der zehnten und der sechzehnten Gestationswoche zu bilden, wobei die vollständige Konfiguration etwa mit der vierundzwanzigsten Woche feststeht. Der Prozess wird zum Teil genetisch gesteuert, denn die Musterklasse, ob ein gegebener Finger Bögen, Schleifen oder Wirbel trägt, ist stark erblich und lässt sich mit einiger Wahrscheinlichkeit aus den Abdrücken der Eltern vorhersagen, aber die spezifischen Minuzien, die einzelnen Ridgeenden, Gabelungen, Umschließungen und Kurzleisten, die die forensisch relevante Detailstruktur bilden, werden durch eine Kaskade von Entwicklungsstochastizität geformt, die ihre genaue Konfiguration selbst aus genetisch identischem Ausgangsmaterial heraus unvorhersagbar macht. Das ist der Grund, warum eineiige Zwillinge trotz gemeinsamen Genoms keine gemeinsamen Abdrücke haben. Dasselbe Genom, exprimiert durch eine Entwicklung unter Bedingungen unterschiedlichen Amniondrucks, unterschiedlicher Blutversorgung, unterschiedlicher fetaler Lage und Dutzender anderer mikroenvironmentaler Variablen, erzeugt Ridgekonfigurationen, die auf der Ebene der spezifischen Minuzien auseinanderlaufen, während die Musterklasse insgesamt erhalten bleibt (MedlinePlus Genetics, National Library of Medicine, 2023, Are fingerprints determined by genetics?).

Die Entwicklungsbiologie erklärt auch die Permanenz der Fingerabdruckmuster über eine gesamte Lebensspanne unter normalen Bedingungen. Die Ridgestrukturen sitzen in der Dermis, unterhalb der Epidermis, verankert in der Papillärschicht der Haut. Oberflächliche Schäden an der Epidermis, eine Verbrennung, ein Schnitt, eine Abrasion, unterbrechen vorübergehend den Oberflächenausdruck der Leisten, verändern aber nicht die darunter liegende Papillärschicht, aus der das Muster sich regeneriert. Nur Verletzungen, die tief genug in die Papillärschicht selbst eindringen, bewirken eine dauerhafte Veränderung, und solche Verletzungen sind typischerweise medizinisch schwerwiegend und äußerlich unverkennbar. Diese Permanenz, kombiniert mit der entwicklungsbedingten Einzigartigkeit, ist das biologische Fundament, auf dem ein Jahrhundert Fingerabdruckbeweise in Gerichtssälen weltweit ruht. Die Biologie hat sich nicht wesentlich verändert, und sie ist stabil. Was sich verändert hat, und was forensisch interessanteres Terrain belegt, ist unser Verständnis dessen, was zwischen der Fingerkuppe und der Gerichtsaussage geschieht.

Die hinterlassene Spur: Sicherung, Enhancement und die Entscheidungen, über die niemand spricht

Nicht alle Fingerabdrücke sind als Beweismittel gleichwertig, und der Typ, der bei kriminalistischen Ermittlungen am häufigsten angetroffen wird, ist zugleich derjenige, der am stärksten Degradierung, Verzerrung und interpretatorischen Herausforderungen ausgesetzt ist. Ein Reibungsleistenabdruck, den ekkrines Schweiß auf einer glatten Oberfläche hinterlässt, ist für das bloße Auge unsichtbar und existiert als Residuum aus Wasser, Aminosäuren, Chloriden, Fettsäuren und Proteinen, das in einem Leistenmuster niedergeschlagen ist und je nach Oberfläche, Umgebung und chemischer Zusammensetzung des Sekrets Minuten oder Jahrzehnte überdauern kann. Diese latente Spur zu sichern, sie in einen für den Vergleich geeigneten Zustand zu bringen und sie dann mit einem bekannten Standard zu vergleichen: jede dieser Stufen führt Variablen ein, die die scheinbare Einfachheit der Gerichtsaussage so gut wie nie adäquat wiedergibt.

Die Wahl der Entwicklungstechnik ist selbst folgenreich, und die Ermittlerin, die sie trifft, schließt Alternativen aus, die informativ hätten sein können. Das Bestäuben mit Aluminium- oder Eisenoxidpulver bleibt die am weitesten verbreitete Methode im Feldbereich, geeignet für glatte, nicht saugende Oberflächen und imstande, eine Leiste-für-Leiste-Visualisierung zu liefern, wenn die Spurenqualität ausreichend ist. Cyanoacrylat-Bedampfung scheidet ein Polymer entlang der Aminosäureketten im Sekretresiduum aus und erweitert die Sicherung auf Oberflächen, auf denen die Pulveradhäsion unzureichend ist. Ninhydrin und verwandte Reagenzien reagieren mit den Aminosäuren im Residuum auf porösen Oberflächen wie Papier. Keine dieser Techniken ist ohne Preis: jede verändert den physischen Zustand des Beweismittels, und die Reihenfolge, in der sie angewendet werden, verlangt erfahrenes Urteilsvermögen, weil manche Techniken das Residuum zerstören, das andere benötigen, und die Entscheidung unwiderruflich ist.

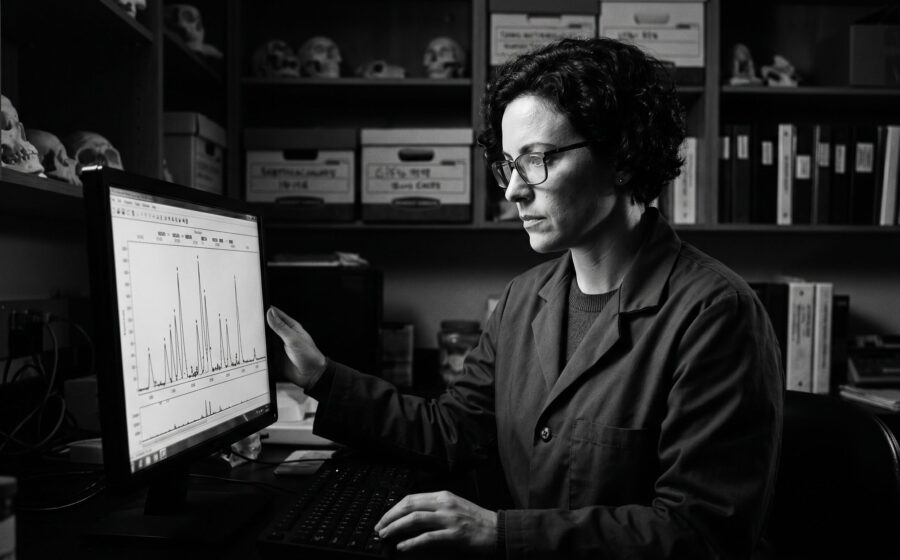

Wo konventionelle Methoden an ihre Grenzen stoßen, hat sich die Multispektral- und Hyperspektralbildgebung als die folgenreichste technologische Entwicklung bei der Latentspur-Sicherung der vergangenen zwei Jahrzehnte erwiesen. Indem die Spurenoberfläche sequenziell über Wellenlängen vom Ultraviolett durch das sichtbare Licht bis ins Nahinfrarot beleuchtet und die differenzielle Reflexions- und Fluoreszenzantwort bei jeder Wellenlänge aufgezeichnet wird, können diese Systeme Leistendetail sichtbar machen, das für konventionelle Fotografie unsichtbar ist, auf Oberflächen, deren optische Komplexität eine Analyse sonst vollständig vereiteln würde, darunter gemusterte Textilien, pigmentierte Kunststoffe und Mehrkomponentenoberflächen, auf denen konventionelles Pulver einen undifferenzierbaren Hintergrund erzeugen würde.

In der Praxis fügt die Technologie eine Entscheidungsebene hinzu, nämlich welche Wellenlängenkombination eingesetzt werden soll, wie die resultierenden Bilder zu interpretieren sind, und, was entscheidend ist, wann digitales Enhancement echtes Detail klargestellt und wann es Artefakt eingeführt hat. Digitale Bildverarbeitung, inzwischen Standard bei der Vorbereitung latenter Spurbilder für den Vergleich, umfasst Operationen von einfacher Kontrastverstärkung über Frequenzbereichsfilterung bis zur KI-gestützten Leistenrekonstruktion. Korrekt angewendet offenbaren diese Operationen echtes Detail, das sonst verloren ginge. Nachlässig angewendet oder unter dem Druck, ein verwendbares Bild aus unzureichendem Ausgangsmaterial zu erzeugen, können sie Leistendetails einführen, die im Originalabdruck nicht vorhanden waren, oder Mehrdeutigkeiten verbergen, die als ehrliche Limitierungen erhalten bleiben sollten. Es gibt kein allgemein akzeptiertes Protokoll, das festlegt, welche Operationen unter welchen Umständen zulässig sind und wie die Verarbeitungshistorie zu dokumentieren ist, und dieser Standardisierungsmangel ist einer der am wenigsten diskutierten Fehlerkanäle der Disziplin.

ACE-V: Das Verfahren, das Versprechen und die strukturelle Schwachstelle

Der forensische Standardansatz für den Fingerabdruckvergleich trägt das Akronym ACE-V, das für Analyse, Vergleich, Auswertung und Verifikation steht, und er wurde in der expliziten Absicht entwickelt, eine systematische Struktur auf das zu legen, was zuvor ein weitgehend implizites und individuell variables Verfahren gewesen war. Zu verstehen, was ACE-V tatsächlich leistet, statt was das Akronym nahelegt, ist notwendig, um sowohl seine genuinen Stärken als auch seine strukturellen Schwachstellen zu beurteilen.

In der Analysephase bewertet die Sachverständige die Latentspur isoliert, bevor sie eine bekannte Spur für den Vergleich gesehen hat. Der Zweck ist, die Qualität der Spur zu beurteilen und festzustellen, welches Detail verlässlich vorhanden ist, wobei das verfügbare Detailniveau auf drei hierarchischen Ebenen identifiziert wird: die Gesamtmusterklasse auf Ebene 1, die spezifischen Leistencharakteristiken einschließlich einzelner Minuzien auf Ebene 2 und das feinste Detail einschließlich Porenlagen und Kantenmorphologie auf Ebene 3. Die Sachverständige entscheidet dann, ob die Spur ausreichend verlässliches Detail enthält, um einen sinnvollen Vergleich zu stützen, und wenn nicht, endet der Prozess. Diese Phase ist die wichtigste in der gesamten Sequenz für die Eindämmung kognitiver Verzerrung, weil sie die Sachverständige auf eine Bewertung der Charakteristiken der Latentspur verpflichtet, bevor sie die bekannte Spur gesehen hat. Wenn diese Phase übersprungen oder unter Zeitdruck komprimiert wird, ist die gesamte nachfolgende Analyse durch das Wissen kontaminiert, wie die bekannte Spur aussieht.

Die Vergleichsphase legt Latent- und Vergleichsspur nebeneinander und untersucht die Übereinstimmung und Divergenz der Merkmale. Die Auswertungsphase liefert eine von drei möglichen Schlussfolgerungen: Identifikation, Ausschluss oder nicht schlüssig. Die Verifikationsphase verlangt, dass eine zweite Sachverständige unabhängig den ACE-Teil des Verfahrens wiederholt und ihre eigene Einschätzung erreicht.

Das Wort unabhängig in diesem Satz enthält die kritische Schwachstelle. Die blinde Verifikation, bei der die zweite Sachverständige die Schlussfolgerung der ersten genuinin nicht kennt, ist die einzige Form der Verifikation, die unabhängige Bestätigung liefert. Die nicht-blinde Verifikation ist funktionell eine Überprüfung einer Schlussfolgerung eher als ein unabhängiger Test von ihr, und die kognitionswissenschaftliche Literatur ist darin eindeutig, dass die Kenntnis der erwarteten Antwort die Wahrscheinlichkeit, bei ihr anzukommen, dramatisch erhöht. Langenburg, Champod und Wertheim demonstrierten 2009, dass wenn Sachverständige die Schlussfolgerung der ersten Sachverständigen kannten, bevor sie ihre Verifikation begannen, die Bestätigungsrate signifikant höher war als wenn sie blind arbeiteten, ohne jede Änderung am tatsächlichen Beweismaterial (Langenburg, G., Champod, C. und Wertheim, P., 2009, Testing for potential contextual bias effects during the verification stage of the ACE-V methodology when conducting fingerprint comparisons, Journal of Forensic Sciences, 54, 571-582). Trotz dieses Befunds bleibt blinde Verifikation in der Praxis weit von universell entfernt.

Ein weiteres strukturelles Problem ist das Fehlen eines universellen Standards für die Mindestzahl übereinstimmender Minuzien, die vor einer Identifikationsschlussfolgerung erforderlich ist. Australien verlangt zwölf Übereinstimmungspunkte, Frankreich und Italien sechzehn, Brasilien und Argentinien dreißig. Die Vereinigten Staaten kennen keinen verbindlichen Schwellenwert. Das bedeutet, dass eine Identifikation eines amerikanischen Sachverständigen und eine Nicht-schlüssig-Schlussfolgerung eines brasilianischen Sachverständigen auf demselben Latentabdruck beruhen und beide mit ihren jeweiligen professionellen Standards vereinbar sein könnten.

Was uns die Fehlerratenstudien wirklich sagen

Der folgenreichste empirische Fortschritt im Verständnis der Fingerabdruckuntersuchungszuverlässigkeit kam aus einer Grundlagenstudie, die 2011 in den Proceedings of the National Academy of Sciences veröffentlicht wurde. Ulery, Hicklin, Buscaglia und Roberts rekrutierten 169 Daktyloskopen aus Bundes-, Landes- und Kommunalbehörden und legten ihnen 744 Fingerabdruckpaare unter verblindeten Bedingungen vor, die verhinderten, dass die Sachverständigen wussten, getestet zu werden.

Die Falsch-positiv-Rate lag bei 0,1 Prozent über die Studienpopulation, sechs falsch-positive Identifikationen aus 4.083 Nicht-Übereinstimmungs-Vergleichen. Die Falsch-negativ-Rate betrug 7,5 Prozent (Ulery, B. T., Hicklin, R. A., Buscaglia, J. und Roberts, M. A., 2011, Accuracy and reliability of forensic latent fingerprint decisions, Proceedings of the National Academy of Sciences, 108, 7733-7738). Diese Zahlen verlangen eine sorgfältige Interpretation, die sie in gerichtlichen Kontexten selten erhalten.

Die Falsch-positiv-Rate von 0,1 Prozent ist nicht die bevölkerungsweite Wahrscheinlichkeit, dass eine gegebene Identifikation fehlerhaft ist. Sie ist die Wahrscheinlichkeit, dass eine Sachverständige, die sich entscheidet, eine Identifikationsaussage zu machen, bei einem Abdruck der Schwierigkeitsstufe dieser Studie, eine fehlerhafte macht. Die Schwierigkeitsstufe war nicht die härtesten Fälle der operativen Praxis. Eine separate Studie des Miami-Dade Police Department aus dem Jahr 2014 erzeugte eine Falsch-positiv-Schätzung von etwa drei Prozent, eine Zahl, die der Präsidentschaftsrat für Wissenschaft und Technologie in seinem Bericht von 2016 als Hinweis zitierte, dass Falsch-positive unter einigen operativen Bedingungen so häufig wie eins in achtzehn Fällen auftreten können (President’s Council of Advisors on Science and Technology, 2016, Forensic Science in Criminal Courts: Ensuring Scientific Validity of Feature-Comparison Methods). Die Diskrepanz zwischen beiden Schätzungen demonstriert, dass das Feld noch keine stabile, allgemein akzeptierte Fehlerrate besitzt. Eine einzelne Zahl einem Gericht als die wissenschaftlich endgültige Antwort zu präsentieren, stellt den Erkenntnisstand falsch dar, und dass das regelmäßig geschieht, ist eines der beharrlichsten Versagen der Disziplin.

Vom Befund zur Aussage: Statistik und was Gerichte tatsächlich hören

Die Übersetzung eines Fingerabdruckvergleichs in eine Gerichtsaussage ist der Punkt, an dem forensische Wissenschaft und juristische Kommunikation am häufigsten in einer Weise auseinanderfallen, die für die Qualität der Rechtsfindung folgenreich ist. Das Vokabular forensischer Gewissheit hat historisch in kategorialen Begriffen operiert: identifiziert, ausgeschlossen, nicht schlüssig, wobei Identifikation als eine Feststellung präsentiert wurde, die einer Fehlerwahrscheinlichkeit so nahe kommt, dass man sie effektiv als null behandeln durfte. Die National Academy of Sciences dokumentierte 2009, dass diese Rahmung wissenschaftlich nicht zu verteidigen ist. Der PCAST-Bericht bekräftigte diese Schlussfolgerung 2016. Keine Mustervergleichsmethode liefert eine kategoriale Aussage gemeinsamer Quelle mit einer Fehlerrate null.

Die statistisch vertretbare Alternative ist der Likelihood-Quotienten-Rahmen, der quantifiziert, um wie viel wahrscheinlicher die beobachtete Übereinstimmung zwischen Latent- und Vergleichsabdruck wäre, wenn sie eine gemeinsame Quelle teilen, als wenn sie es nicht täten. Ein Likelihood-Quotient von zehntausend bedeutet, dass die beobachtete Übereinstimmung zehntausend Mal wahrscheinlicher unter der Hypothese gemeinsamer Quelle ist als unter der Hypothese zufälliger Koinzidenz. Das ist eine bedeutungsvolle Aussage über das Beweisgewicht, und es ist der Rahmen, den die meisten seriösen forensischen Statistiker als die korrekte Ausdrucksweise von Fingerabdruckbeweisen betrachten.

Die praktische Herausforderung besteht darin, dass die meisten operativen Fingerabdrucklabore keine Likelihood-Quotienten für die Routine-Fallarbeit berechnen, die meisten Daktyloskopen nicht darauf trainiert sind, sie zu berechnen, und die meisten Gerichte nicht daran gewöhnt sind, Fingerabdruckbeweise in probabilistischer Form zu empfangen. Die Disziplin befindet sich im Übergang, aber der Übergang ist langsam, und die Lücke zwischen dem, was die Beweise stützen, und dem, was das Gericht hört, bleibt real und folgenreich.

Was eine Jury typischerweise hört, ist dieses: Die Sachverständige untersuchte den Latentabdruck vom Tatort und den bekannten Abdruck des Angeklagten, und sie schloss, dass sie übereinstimmen. Die wissenschaftliche Realität ist, dass diese Aussage, ohne Quantifizierung der Wahrscheinlichkeit, ohne Charakterisierung der Qualität des Latentabdrucks, ohne Anerkennung der Fehlerratenliteratur, erheblich mehr Gewissheit vermittelt, als die Beweise stützen.

AFIS, Künstliche Intelligenz und die Automatisierungslücke

Automatisierte Fingerabdruckidentifikationssysteme haben den Maßstab, in dem Fingerabdruckbeweise eingesetzt werden können, transformiert und die Disziplin aus einer Welt herausbewegt, in der ein Latentabdruck manuell gegen einige hundert bekannte Abdrücke verglichen werden konnte, in eine, in der er in Sekunden gegen Datenbanken mit Hunderten von Millionen Exemplaren durchsucht werden kann. Das Next Generation Identification System des FBI und seine nationalen Entsprechungen in Deutschland, dem Vereinigten Königreich, Frankreich und anderswo stellen die größten organisierten Sammlungen biometrischer Identifikationsdaten dar, die je zusammengestellt wurden.

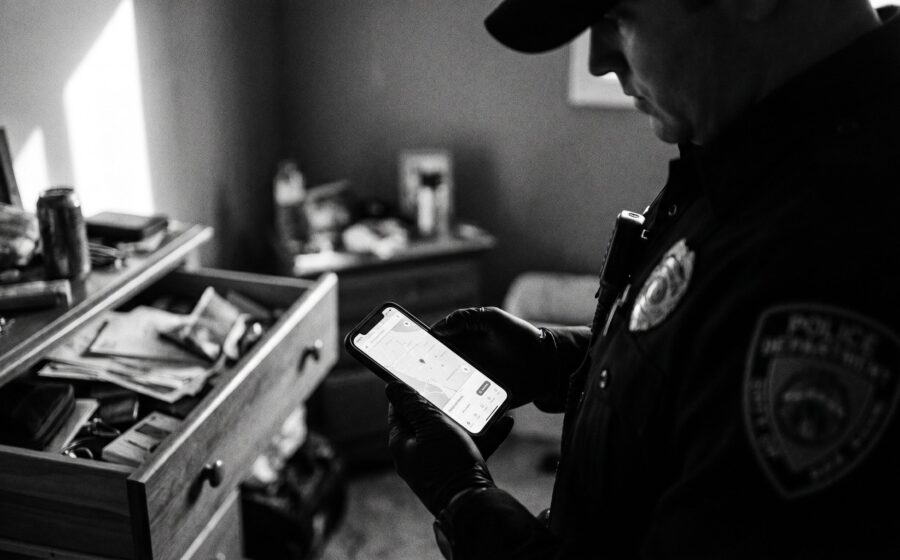

Was AFIS leistet und was es nicht leistet, ist gleichermaßen wichtig. Das System vergleicht kodierte Fingerabdruckdaten, keine Rohbilder, und liefert eine gerankte Liste von Kandidaten-Übereinstimmungen oberhalb eines konfigurierbaren Schwellenwerts. Es ist explizit kein Identifikationssystem. Kein AFIS in routinemäßigem operativem Betrieb erklärt eine Identifikation: das System liefert Kandidaten, und eine menschliche Sachverständige muss diese Kandidaten dann mittels ACE-V bewerten, um zu einer Identifikationsschlussfolgerung zu gelangen. Die Systemausgabe ist der Ausgangspunkt für menschliche Analyse, nicht ihr Endpunkt.

Diese Architektur hat eine wichtige Implikation für kognitiven Bias. Wenn AFIS eine Kandidatenliste zurückgibt, die eine bestimmte Person mit einem hohen Ähnlichkeitsscore auf Rang eins platziert, nähert sich die menschliche Sachverständige dem Vergleich nicht als neutraler analytischer Übung: sie ist durch das Ranking des Systems grundiert. Der Kandidat mit dem höchsten Score ist derjenige, den sie zuerst vergleicht, und sie arbeitet unter einer impliziten Erwartung, dass dies die wahrscheinliche Übereinstimmung ist. Die kontextuelle Kontamination, die Dror über forensische Disziplinen hinweg dokumentiert hat, gilt mit gleicher Stärke für AFIS-Ausgaben, und der Effekt des AFIS-Rankings auf nachfolgende Sachverständigenurteile ist ein Bereich, dessen Ergebnisse noch nicht vollständig in die operative Praxis eingedrungen sind.

Künstliche Intelligenz wird inzwischen an mehreren Punkten im Latentspurworkflow eingesetzt, von der automatisierten Qualitätsbewertung über KI-gestützte Leistenenhancement bis zu Deep-Learning-basierten Matching-Algorithmen, die in NIST-Benchmarks unter bestimmten Bedingungen traditionelle minutienbasierte AFIS übertroffen haben. Die praktische Herausforderung ist die Übertragung kontrollierter Benchmark-Ergebnisse in die operative Umgebung. KI-Systeme, die auf verfügbaren Daten trainiert wurden, können auf Spurtypen oder Untergrundsubstraten systematisch schlechter abschneiden, die in ihren Trainingsdaten unterrepräsentiert sind, und es existiert derzeit kein etablierter Rahmen zur Charakterisierung dieser operativen Leistungslücken, bevor eine Technologie in der Fallarbeit eingesetzt wird.

Fälle aus der Praxis: Wie die schwierigen Fälle wirklich aussehen

Die Fälle, die die eigentlichen operativen Herausforderungen der Fingerabdruckbeweise am deutlichsten beleuchten, sind nicht die Identifikationen von einem klaren Abdruck auf einer trockenen glatten Oberfläche, die zuverlässig funktionieren und wenig analytische Schwierigkeit aufwerfen. Es sind die Fälle, in denen der Abdruck partiell ist, durch Wasser, Hitze oder Kontamination degradiert, oder auf einer Oberfläche niedergeschlagen, deren optische Eigenschaften die Standard-Sicherungsmethoden besiegen.

Ich bearbeitete einen Einbruchsfall, in dem ein Latentabdruck von einem regenbenetzten Fensterrahmen gesichert worden war, und das Bild zeigte ausreichend Leistendetail für einen sinnvollen Vergleich, aber die durch den Wasserkontakt eingeführte Verzerrung hatte Leistensegmente auf eine Weise versetzt, die ihre Beziehung zu benachbarten Leisten mehrdeutig machte. Der Vergleich mit dem bekannten Abdruck des Verdächtigen zeigte eine Menge übereinstimmender Merkmale und eine Menge scheinbarer Diskordanzen, die, je nachdem wie die Verzerrung modelliert wurde, eine gemeinsame Quelle stützen oder widerlegen konnten. Die ehrliche Schlussfolgerung, zu der ich nach gründlicher Analyse kam, war: nicht schlüssig. Was eine weniger sorgfältige Sachverständige oder eine unter operativem Druck arbeitende Person mit jenem Abdruck gemacht hätte, ist eine offene Frage, die der Mangel an dokumentierten Entscheidungsstandards unbeantwortbar macht.

Ein Mordfall mit Multispektral-Sicherung von einem gemusterten Textil illustriert die Stärke der Technologie und ihre Anforderungen gleichzeitig. Der Abdruck war unter allen konventionellen Beleuchtungsbedingungen unsichtbar, und Standardpulverentwicklung auf dem Stoff erzeugte undifferenzierbaren Hintergrund. Multispektral-Bildgebung im Nahultraviolettbereich enthüllte Leistenstruktur, die mit den Ebene-1- und Ebene-2-Charakteristiken eines Fingerabdrucks übereinstimmte. Zwei Sachverständige waren sich über die Schlussfolgerung uneinig: eine erreichte Identifikation, eine nicht schlüssig. Eine dritte Sachverständige, die blind ohne Kenntnis der ersten beiden Schlussfolgerungen arbeitete, kam ebenfalls zu nicht schlüssig. Der Fall wurde auf der Grundlage von DNA-Beweisen entschieden, und die Fingerabdruckidentifikation ging nicht vor Gericht, was angesichts des Beweiszustands die richtige Entscheidung war. In einer Jurisdiktion ohne Blindverifikationsverfahren hätte die Uneinigkeit vielleicht nie offen gelegt werden können.

Die Ethik der Gewissheit

Die ethische Dimension der Präsentation von Fingerabdruckbeweisen ist kein weicher Anhang zur harten Wissenschaft. Sie ist in ihr verankert, weil die wissenschaftliche Erkenntnistheorie der Fingerabdruckuntersuchung eine probabilistische statt eine kategoriale Ausdrucksweise von Schlussfolgerungen verlangt, und das Versagen, dies klar an Gerichte zu kommunizieren, stellt eine wissenschaftliche Fehlinformation dar, unabhängig von der Absicht irgendeiner einzelnen Sachverständigen.

Eine Sachverständige, die aussagt, sie habe den Angeklagten als Quelle des Latentabdrucks vom Tatort identifiziert, und dass in dieser Identifikation keine Fehlermöglichkeit bestehe, macht eine Behauptung, die die wissenschaftliche Literatur nicht stützt. Der Bericht der National Academy of Sciences sagte das 2009 explizit. Der PCAST-Bericht sagte es 2016 erneut. Das gerichtliche Vokabular hat sich nicht so schnell verändert wie das wissenschaftliche Verständnis, und die Entfernung zwischen beiden ist der Ort, an dem Menschen zu Unrecht verurteilt wurden.

Fingerabdrücke sind am stärksten, wenn sie Teil einer Beweiskonstellation sind, wenn eine zuverlässige Identifikation, mit angemessener statistischer Qualifikation ausgedrückt, durch DNA, digitale Spuren, Zeugenaussagen und Verhaltensbefunde korroboriert wird, die unabhängig voneinander auf dieselbe Schlussfolgerung hinweisen. Der Wert der Disziplin nimmt nicht ab, wenn sie ehrlich mit ihren Grenzen präsentiert wird. Ehrliche Unsicherheitskommunikation ist die Vorbedingung für rationale Beweiswertabschätzung. Und rationale Beweiswertabschätzung ist das, was Gerechtigkeit von der forensischen Wissenschaft braucht, nicht mehr und nicht weniger.

Die vollständige technische und statistische Analyse, die diesem Beitrag zugrunde liegt, ist verfügbar in Rauscher und Morgott (2025), unten referenziert.

Quellen

- Dror, I. E., Charlton, D. und Peron, A. (2006). Contextual information renders experts vulnerable to making erroneous identifications. Forensic Science International, 156(1), 74-78.

- Langenburg, G., Champod, C. und Wertheim, P. (2009). Testing for potential contextual bias effects during the verification stage of the ACE-V methodology when conducting fingerprint comparisons. Journal of Forensic Sciences, 54(3), 571-582.

- MedlinePlus Genetics, National Library of Medicine (2023). Are fingerprints determined by genetics? National Institutes of Health.

- National Research Council, National Academy of Sciences (2009). Strengthening Forensic Science in the United States: A Path Forward. National Academies Press.

- President’s Council of Advisors on Science and Technology (2016). Forensic Science in Criminal Courts: Ensuring Scientific Validity of Feature-Comparison Methods. Executive Office of the President.

- Rauscher, G. A. und Morgott, M.-L. (2025). Forensic Fingerprint Analysis: Evaluating Scientific Foundations, Technological Innovations, and Judicial Implications. International Institute of Forensic Expertise, Starnberg. https://doi.org/10.5281/zenodo.15101173

- Ulery, B. T., Hicklin, R. A., Buscaglia, J. und Roberts, M. A. (2011). Accuracy and reliability of forensic latent fingerprint decisions. Proceedings of the National Academy of Sciences, 108(19), 7733-7738.