Die Illusion der Objektivität: Wie Bias in die Forensik eindringt, bevor die Analyse überhaupt beginnt

Wenn der Sachverständige nicht neutral ist, ist es die Spur auch nicht. Der Bericht eines Forensikers über die Mechanismen, die Fälle und die strukturellen Versagen, die niemand im Justizsystem zu genau unter die Lupe nehmen möchte.

Ich habe Bias mehr gesehen, als ich zählen kann, und das Schlimmste daran ist nicht, dass er existiert. Das Schlimmste ist, dass er für die Menschen unsichtbar ist, die ihn tragen. Ich habe ihn durch Gerichtssäle ziehen sehen, durch Labore, durch vereidigte Aussagen, die mit einer Sicherheit vorgetragen wurden, die jeden Wissenschaftler beschämt hätte, der den Unterschied zwischen Zuversicht und Wissen versteht. Ich habe beobachtet, wie er das Leben von Menschen zerstörte, die nichts weiter auf dem Kerbholz hatten, als im falschen Moment in der falschen Akte zu stecken. Und ich habe Gutachten geschrieben, die beim Namen nannten, was ich sah, sachlich und ohne Entschuldigung, und dafür eine Art institutioneller Feindseligkeit geerntet, die einen von einem Gericht zum nächsten begleitet, nicht weil meine Analyse falsch war, sondern weil sie unbequem war.

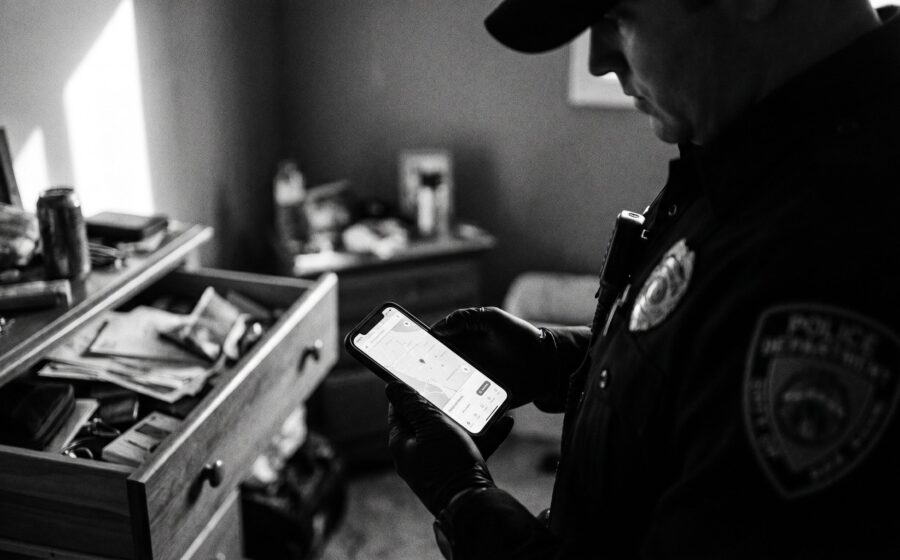

Lassen wir uns klar über etwas sein, das das System vor offenem Gericht selten einräumt. Ein Sachverständiger aus einem staatlichen Landeskriminalamt oder, in den Vereinigten Staaten, aus dem FBI oder einem vergleichbaren Behördenapparat, der als neutraler Sachverständiger der Anklage erscheint, ist nicht neutral. Er ist Teil des institutionellen Ökosystems der Anklage. Er wurde von diesem System ausgebildet, von ihm akkreditiert, und kehrt am nächsten Montag dorthin zurück. Die Vorstellung, dass diese strukturelle Einbettung keinerlei Spur in seiner Analyse hinterlässt, dass er Beweise mit derselben distanzierten Ausgeglichenheit bewertet, die er an einen rein wissenschaftlichen Laborvorgang anlegen würde, ist keine Hypothese, die das empirische Material stützt. Es ist eine juristische Fiktion, die das System aufrechterhalten muss, weil ihre Aufgabe erfordern würde, die gesamte Architektur des Sachverständigenwesens zu überdenken.

Ich habe Sachverständige beobachtet, die wirklich neutral waren und deshalb ihre Gerichtsaufträge verloren, nicht weil ihre Analysen fehlerhaft waren, sondern weil sie sich weigerten, ihre Schlussfolgerungen in Richtung des Ergebnisses zu biegen, das die auftragserteilende Behörde erwartete. Der Mechanismus ist nie explizit. Niemand sagt einem Sachverständigen jemals, er solle ein Ergebnis verzerren, aber die Rückkopplungsschleife ist präzise und konsistent. Sachverständige, die unbequeme Schlussfolgerungen liefern, hören auf, Aufträge zu erhalten. Sachverständige, die bequeme liefern, tauchen immer wieder auf, Fall für Fall, auf Wunsch derselben Staatsanwälte und Ermittler, deren Namen durch eine stille institutionelle weiße Liste rotieren, die niemand schriftlich bestätigt und jeder im Stillen versteht.

Das Experiment, das bewies, was alle bestritten

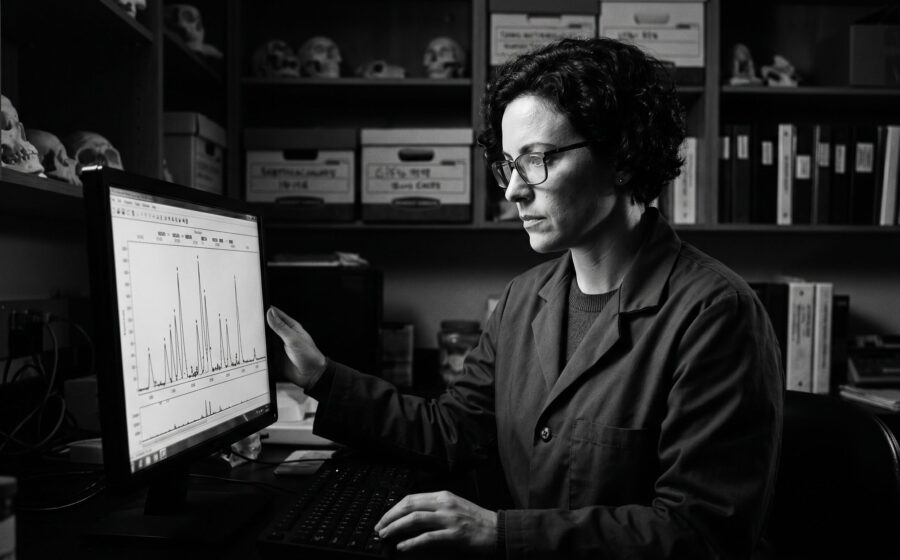

Im Jahr 2006 veröffentlichte der kognitive Neurowissenschaftler Itiel Dror gemeinsam mit seinem Kollegen Dave Charlton eine Studie, die seither zu den meistzitierten und unbequemsten Arbeiten in der Geschichte der Forensik zählt. Sie nahmen Fingerabdrücke, die erfahrene Spurenkundler bereits analysiert und förmlich als Übereinstimmung mit einem Verdächtigen identifiziert hatten, abgeschlossene Fälle, die Einschätzungen getroffen, die Akten archiviert, und präsentierten genau dieselben Abdrücke denselben Sachverständigen erneut, diesmal begleitet von Kontextinformationen, die auf die entgegengesetzte Schlussfolgerung hindeuteten, nämlich dass die Abdrücke nicht übereinstimmten und der Verdächtige ein solides Alibi besaß. Vier von fünf Sachverständigen änderten ihr Urteil. Nicht weil sich die Abdrücke verändert hatten. Weil sich die sie umgebende Information verändert hatte (Dror, Charlton und Peron, 2006, Contextual information renders experts vulnerable to making erroneous identifications, Forensic Science International, 156, 74-78).

Dieses Ergebnis wurde von der Gemeinschaft der Fingerabdruckexperten zunächst mit dem empfangen, was man nur als organisierten Widerstand bezeichnen kann, und der Widerstand war verständlich, denn was die Studie demonstrierte, war, dass eine Disziplin, die seit Jahrzehnten vor Gericht nahezu unfehlbar aufgetreten war, unter messbaren experimentellen Bedingungen genau jener Art kognitiver Kontamination ausgesetzt ist, über die jeder Psychologiestudent im ersten Semester lernt. Die Sachverständigen in Drors Studie waren nicht inkompetent, nicht korrumpiert, nicht nachlässig. Sie waren Menschen, und Menschen verarbeiten Information auf eine Weise, bei der frühere Erwartungen nach unten auf Wahrnehmungsdaten kaskadieren und beeinflussen, was das Auge dem Gehirn meldet, bevor das Gehirn entschieden hat, was es betrachtet.

Dror dokumentierte in der Folge denselben Effekt bei der Interpretation von DNA-Mischspuren, bei der Bissspur-Analyse, der Blutspurenmusteranalyse, der Toxikologie, der Schusswaffen-Untersuchung und der Schriftgutachten. In einer 2011 gemeinsam mit Hampikian veröffentlichten Studie beschrieb er einen tatsächlichen Vergewaltigungsfall, in dem eine DNA-Mischspur von siebzehn unabhängigen Sachverständigen analysiert worden war, von denen dreizehn den Angeklagten ausschlossen, als sie ausschließlich mit den Rohdaten arbeiteten, während ihn nur einer einschloss, und dieser Einschluss war unter Bedingungen erfolgt, in denen der Sachverständige wusste, dass ein kooperierender Zeuge bereits ausgesagt hatte, dieser Angeklagte sei anwesend gewesen (Dror und Hampikian, 2011, Subjectivity and bias in forensic DNA mixture interpretation, Science and Justice, 51, 204-208). Der Ausdruck auf der Seite hatte sich nicht verändert. Der Kontext hatte es. Und der Kontext steuerte die Schlussfolgerung.

Bis 2020 hatte Dror drei Jahrzehnte Forschung in eine Taxonomie aus acht Quellen von Bias und sechs Expertenfehlannahmen synthetisiert, die sich über forensische Disziplinen hinweg wiederholen, und ein Modell beschrieben, in dem fallspezifische Informationen, persönliche Geschichte und institutionelles Umfeld zusammenwirken, um das zu kontaminieren, was nominell ein rein technisches Urteil ist (Dror, 2020, Cognitive and human factors in expert decision making: Six fallacies and the eight sources of bias, Analytical Chemistry, 92, 7998-8004). Die zerstörerischste seiner sechs Fehlannahmen ist die letzte, nämlich der Glaube des Experten, dass seine Erfahrung ihn vor Bias schützt. Die Forschung ist darin einhellig: Expertise verleiht keine Immunität. In mehreren dokumentierten Fällen verstärkt sie den Effekt, weil das Musterkennungssystem des Experten darauf trainiert wurde, Übereinstimmungen zu finden, und es findet sie, auch wenn sie nicht eindeutig vorhanden sind.

Brandon Mayfield und die Hundert-Prozent-Übereinstimmung, die keine war

Der Fall, der am sichtbarsten ins öffentliche Bewusstsein eingebrochen ist, betrifft Brandon Mayfield, einen Familienanwalt aus Portland, Oregon, der nichts mit den Madrider Zuganschlägen vom 11. März 2004 zu tun hatte, bei denen 191 Menschen getötet und ungefähr 1.500 weitere verletzt wurden. An einem Beutel mit Sprengkapselanschlüssen in der Nähe des Tatorts war ein Teilfingerabdruck sichergestellt worden. Die Spanische Nationalpolizei übermittelte ein digitales Bild des Abdrucks über Interpol an das FBI. Das automatisierte Fingerabdruck-Identifikationssystem des FBI lieferte eine Liste von zwanzig Kandidaten. Mayfield stand auf dieser Liste.

Mehrere erfahrene FBI-Daktyloskopen führten das formal als ACE-V bekannte Analyseverfahren durch, wobei das Akronym für Analyse, Vergleich, Auswertung und Verifikation steht. Sie schlossen gemeinsam und mit förmlicher Dokumentation, dass Mayfields Abdruck mit hundert Prozent Sicherheit übereinstimmt. Ein gerichtlich bestellter unabhängiger Sachverständiger kam zur selben Schlussfolgerung. Das FBI verhaftete Mayfield am 6. Mai 2004, hielt ihn als Zeugen in Gewahrsam, durchsuchte seine Wohnung und sein Büro, und bestand auch nach einem Schreiben der Spanischen Nationalpolizei vom 13. April, in dem diese ausdrücklich festgestellt hatte, dass der Abdruck nicht mit Mayfield übereinstimme und sie einen anderen Verdächtigen identifiziert hätten, weiter auf der Übereinstimmung.

Er wurde zwei Wochen später freigelassen, als die Presse die Meldung verbreitete, dass die spanischen Behörden den Abdruck dem algerischen Staatsangehörigen Ouhnane Daoud zugeordnet hatten. Das FBI entschuldigte sich öffentlich. Mayfield erhielt als Vergleich nahezu zwei Millionen Dollar. Eine Untersuchung des Generalinspektors des Justizministeriums aus dem Jahr 2006 identifizierte die Ursachen. Die Sachverständigen hatten Verzerrungen im Teilabdruck als Merkmale fehlgedeutet, die zu Mayfields Abdrücken korrespondieren sollten, hatten die schlechte Qualität des digitalen Bildes nicht ausreichend gewichtet, und hatten, entscheidend, zugelassen, dass Hintergrundinformationen über Mayfield in ihre Wahrnehmungsverarbeitung einflossen, nämlich seinen muslimischen Glauben, seine frühere Vertretung eines verurteilten Terroristen, seine in Ägypten geborene Frau und seine Mitgliedschaft in einer Moschee, ohne dass dieser Einfluss je explizit gemacht worden wäre (Office of the Inspector General, U.S. Department of Justice, 2006, A Review of the FBI’s Handling of the Brandon Mayfield Case).

Der Bericht des Generalinspektors enthält einen Satz, der gerahmt und in jedem forensischen Labor der Welt aufgehängt werden sollte. Einer der Sachverständigen hatte eingeräumt, dass man, wenn die identifizierte Person jemand ohne diese Merkmale gewesen wäre, die Identifizierung möglicherweise mit mehr Skepsis betrachtet hätte. Das Leben eines Mannes brach zusammen, weil die Vorannahmen der Sachverständigen darüber, wer verdächtig ist, einen partiellen, mehrdeutigen Abdruck wie Gewissheit erscheinen ließen.

Die Anatomie des Vorgangs

Was folgt, ist keine Auflistung abstrakter kognitiver Kategorien, sondern eine Beschreibung von Mechanismen, die ich in realen Fällen beobachtet habe, über Disziplinen hinweg und bei Praktikern, die in anderen Kontexten als gewissenhafte Fachleute gelten könnten. Sie teilen ein gemeinsames Merkmal: Sie sind für die Person, bei der sie ablaufen, unsichtbar, und sie werden dramatisch sichtbarer, sobald der Ausgang eines Falls bekannt ist.

Der Bestätigungsfehler ist der am gründlichsten dokumentierte und der folgenreichste. Sobald ein Ermittler oder Sachverständiger eine Arbeitshypothese gebildet hat, wirkt diese Hypothese als Filter, der mit der erwarteten Schlussfolgerung konsistente Befunde bevorzugt und widersprechende Befunde nach einem strengeren Rechtfertigungsmaßstab bewertet. Das Ergebnis ist eine systematische Asymmetrie in der angewandten Überzeugungsschwelle für belastende und entlastende Befunde, und diese Asymmetrie ist von innen unsichtbar, weil sie sich wie Urteilsvermögen anfühlt.

Der Kontextfehler ist der Bestätigungsfehler, der auf einem spezifischen Informationskanal operiert, nämlich Hintergrundinformationen über den Fall oder den Verdächtigen, die für die technische Frage irrelevant sind, aber im selben Informationspaket ankommen. In den meisten Strafverfolgungssystemen erhalten forensische Sachverständige die vollständige Verfahrensakte, die nicht nur die physischen Beweise enthält, sondern auch das Ermittlungsnarrativ, die Vorstrafen des Verdächtigen, die Anklageschrift und häufig die ausgedrückte Einschätzung des ermittelnden Beamten. Der Effekt ist, dass die Rahmung der Beweisfrage gesetzt ist, bevor die Sachverständige die Beweise betrachtet, und sie wird durch Menschen gesetzt, die ein Interesse am Ausgang haben.

Der Parteinahme-Fehler entwickelt sich graduell bei Sachverständigen, die wiederholt für dieselbe Seite tätig sind. Was passiert, ist eine langsame Angleichung interpretativer Gewohnheiten, eine allmähliche Kalibrierung der Schwelle zum Ausdruck von Zweifel auf das Niveau, das die auftragserteilende Partei implizit als nützlich demonstriert hat. Der Sachverständige beginnt zu klingen wie seine Auftraggeber, ohne zu wissen, wann die Verschiebung eingetreten ist.

Der Auswahlbias operiert auf dem, was in den abschließenden Bericht aufgenommen wird. Ein Sachverständiger, der im Verlauf seiner Arbeit Befunde notiert hat, von denen einige die Hypothese stützen und andere sie widersprechen, steht beim Schreiben vor einer strukturell unbequemen Wahl. In vielen Jurisdiktionen existiert kein Verfahrensweg, der eine Offenlegung entlastender Befunde erzwingt. Was vor Gericht erscheint, ist daher keine vollständige Bilanzierung, sondern eine kuratierte Auswahl.

Der Anker-Fehler beschreibt das kognitive Gewicht, das die zuerst eingegangene Information trägt. Im forensischen Kontext ist das fast immer Information, die vom Ermittler bereitgestellt wird, bevor der Sachverständige Zugang zu den Beweisen hat. Spätere Befunde werden relativ zu diesem Anker bewertet, und Abweichungen von ihm tragen eine zusätzliche kognitive Rechtfertigungslast.

Der Überzeugungsfehler produziert die katastrophalsten Gerichtsaussagen, weil das Justizsystem Zuversicht belohnt und Zweifel bestraft. Der Bericht der National Academy of Sciences von 2009 dokumentierte diese Dynamik explizit und stellte fest, dass forensische Sachverständige routinemäßig eine Gewissheit ausdrücken, die ihre Methoden in wissenschaftlichen Begriffen nicht stützen können.

Der blinde Fleck ist das Meta-Problem. Es ist der Glaube, dass das Bewusstsein für kognitiven Bias an sich schützend gegen ihn wirkt. Drors Forschung ist eindeutig: Das Wissen, dass Bias existiert, verhindert nicht, dass er operiert. Der Sachverständige, der ein Seminar besucht hat und ins Labor zurückgekehrt ist in der Überzeugung, nun immunisiert zu sein, ist nach Drors Taxonomie der Praktiker mit dem höchsten Risiko im Raum.

Zwanzig Jahre fehlerhafte Aussagen: Die Haaranalyse-Katastrophe des FBI

Die systematischste Dokumentation dessen, was institutioneller Bias in großem Maßstab produziert, ist die Haarvergleichs-Überprüfung des FBI, die 2013 begann und deren erste Ergebnisse, 2015 veröffentlicht, enthüllten, dass Behördensachverständige in mehr als 90 Prozent der untersuchten Fälle wissenschaftlich ungültige Aussagen gemacht hatten, und dass diese Aussagen dazu verwendet worden waren, Angeklagte in Prozessen zu belasten, die über einen Zeitraum von zwanzig Jahren stattgefunden hatten (FBI, 2015, FBI testimony on microscopic hair analysis contained errors in at least 90 percent of cases in ongoing review).

Der Präsidentschaftsrat für Wissenschaft und Technologie berichtete 2016, dass FBI-Sachverständige in mehr als 95 Prozent der geprüften Fälle wissenschaftlich ungültige Aussagen gemacht hatten (PCAST, 2016). Die Sachverständigen erfanden keine Beweise. Sie führten eine Analyse durch, deren Grundlagen nie durch kontrollierte Studie validiert worden waren, drückten Schlussfolgerungen in einer Sprache aus, die die wissenschaftliche Literatur nicht autorisiert hatte, und taten dies zwei Jahrzehnte lang unter der impliziten institutionellen Erwartung, dass dies das war, was die Gerichte verlangten und was Staatsanwälte für nützlich hielten.

Das Innocence Project hat 74 Menschen dokumentiert, die auf der Grundlage mikroskopischer Haarvergleiche verurteilt und später durch DNA-Tests entlastet wurden. Einer davon ist George Perrot, der nahezu dreißig Jahre für eine Vergewaltigung im Gefängnis saß, die er nicht begangen hatte. Ein anderer ist Steven Chaney, der in Texas wegen Mordes zum Teil auf der Grundlage von Bissmarkenbefunden verurteilt wurde und 28 Jahre inhaftiert war, bevor die texanischen Gerichte den Beweistyp aufgaben und ihn rehabilitierten.

Das strukturelle Problem, das keine Reform bisher angetastet hat

Was die Einzelfallstudien und die experimentelle Literatur gemeinsam haben, ist eine Diagnose, die über das Verhalten einzelner Sachverständiger hinaus auf die Architektur des Systems zeigt, in dem sie operieren. Forensisch-wissenschaftliche Labore sind in der Mehrheit der Jurisdiktionen keine unabhängigen wissenschaftlichen Institutionen. Sie werden von Strafverfolgungsbehörden finanziert, administrativ bei ihnen angesiedelt und operativ von ihnen beaufsichtigt. Die Analytikerin, die die Beweise in einem Straffall untersucht, ist Angestellte desselben institutionellen Komplexes, der den Fall zusammengestellt, den Verdächtigen verhaftet und ein Interesse an der Verurteilung hat. Diese strukturelle Einbettung erzeugt Drücke, die auf der Ebene von Kultur und Erwartung operieren, und es ist genau deshalb, dass Praktiker, die ihnen ausgesetzt sind, sie typischerweise nicht spüren.

Die Unabhängigkeit forensischer Labore von der Strafverfolgungsverwaltung wurde von der National Academy of Sciences, dem PCAST-Bericht, zahlreichen Berufsverbänden und jeder ernsthaften akademischen Analyse des Problems in den vergangenen zwei Jahrzehnten empfohlen. Die Reform wurde in keiner Jurisdiktion in nennenswertem Umfang umgesetzt, und der Grund hat nichts mit technischer oder finanzieller Machbarkeit zu tun. Sie wurde nicht umgesetzt, weil die Institutionen, die die Kontrolle abgeben müssten, dieselben Institutionen sind, die von der gegenwärtigen Regelung profitieren.

Was ich aus eigenen Fällen weiß

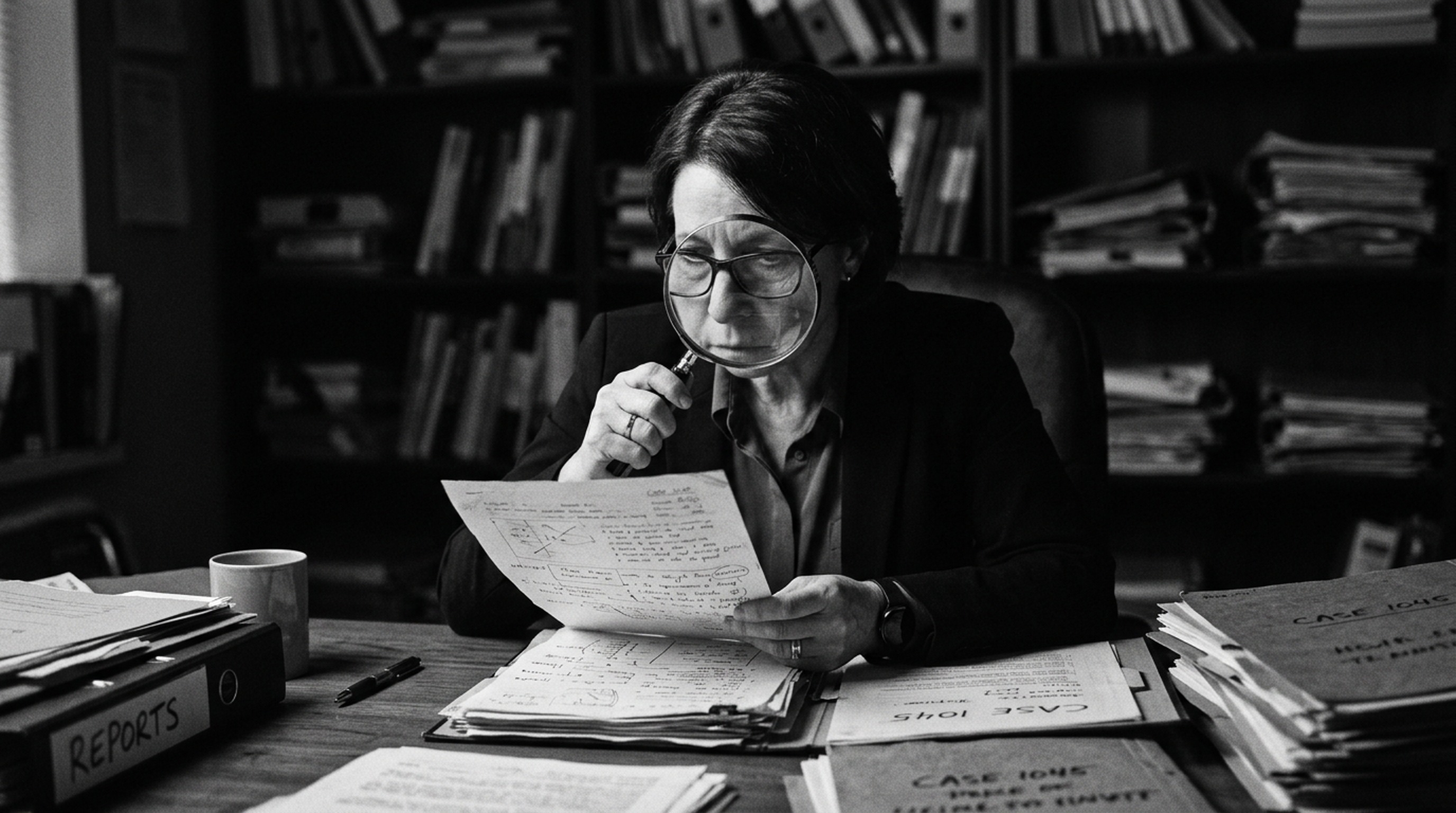

Es gab einen Fall, den ich nicht im Einzelnen benennen werde, der aber alles, was ich beschrieben habe, in einem einzigen Sachverhalt bündelt. Ein Humanbiologe wurde als Sachverständiger berufen und sagte vor Gericht aus, dass ein Verdächtiger, der in einem Videomaterial vollständig maskiert erschien, mit einer Wahrscheinlichkeit von 99,72 Prozent identifiziert werden könne. Eine maskierte Gestalt. Ohne sichtbare Gesichtsmerkmale. Ohne biometrischen Anker irgendeiner konventionellen Art. Die Grundlage der Identifizierung war, dass ähnliche Kleidung über dieselbe Online-Plattform gekauft worden war. Der Professor kannte diese Kontextinformation, bevor er das Videomaterial analysierte. Die Kontextinformation formte, was er aus dem Material schloss, und die Schlussfolgerung kam mit einer statistischen Präzision, die in keinem Verhältnis stand zu dem, was die Methode tatsächlich stützen konnte.

Ich schrieb ein methodenkritisches Gutachten zu diesem Fall. Es war sachlich, gründlich und belegte die relevante Literatur. Es war auch tief unwillkommen. Ein Gutachten, das die Identifizierungswahrscheinlichkeit eines Kollegen als wissenschaftlich unhaltbar bezeichnet, wird nicht als Beitrag zur wissenschaftlichen Genauigkeit empfangen, sondern als Angriff auf eine professionelle Allianz. Ich weiß, welche Gerichte mich nicht rufen und warum. Ich trage dieses Wissen ohne Verlegenheit, weil die Alternative darin bestünde, Gutachten zu schreiben, die auf die Erwartungen der Auftragserteilenden kalibriert sind, und das ist ein Kompromiss, den ich nicht eingehen werde.

Die Frage, die mehr direkte Aufmerksamkeit verdient als sie typischerweise erhält, ist nicht, ob einzelne Sachverständige befangen sind, denn das empirische Material ist inzwischen reichhaltig und unwidersprochen. Die Frage ist, ob das Justizsystem das Problem überhaupt gelöst haben will. Richter, die Jahr für Jahr dieselben Sachverständigen rufen, wissen auf einer gewissen Ebene, dass sie sie rufen, weil diese Sachverständigen verlässliche Ergebnisse liefern, und verlässlich bedeutet in diesem Kontext verlässlich ausgerichtet auf die Tattheorie der Anklage.

Was tatsächlich hilft

Die forensisch-wissenschaftliche Literatur zur Bias-Eindämmung ist besser entwickelt als die Umsetzung ihrer Empfehlungen vermuten lässt. Mehrere Maßnahmen haben unter kontrollierten Bedingungen messbare Wirksamkeit demonstriert, und die Lücke zwischen dem, was bekannt ist, und dem, was praktiziert wird, ist selbst ein Datenpunkt über den Reformwillen des Systems.

Das linear-sequenzielle Enthüllen ist der methodisch am sorgfältigsten validierte Ansatz. Er verlangt, dass die Analytikerin sich zu jedem Analyseschritt bekennt, bevor sie das nächste Stück Kontextinformation erhält, was die Bewertung der Beweise in eine Richtung strukturiert, die vom Spurenbefund nach außen zum Kontext verläuft, anstatt von der Ermittlungshypothese nach innen zu den Beweisen. Das Verfahren wurde vom NIST förmlich empfohlen. Es bleibt die Ausnahme und nicht der Standard.

Die Blindverifizierung, bei der die Analytikerin, die die erste Überprüfung durchführt, die Schlussfolgerung der ersten Analytikerin nicht kennt, hat sich als geeignet erwiesen, den Kaskadeneffekt zu unterbrechen. Sie erfordert zusätzliche Personalplanung und entzieht dem Verifizierungsschritt den institutionellen Druck zu bestätigen statt anzufechten.

Die Entfernung des Fallkontexts aus der Erstanalyse, was bedeutet, der Analytikerin die physischen Beweise und die technische Frage zu geben, ohne das Ermittlungsnarrativ, die Vorgeschichte des Verdächtigen oder die Anklagehypothese, ist konzeptuell einfach und technisch anspruchslos. Die institutionelle Hürde ist dieselbe wie bei allen anderen Reformen: Die Menschen, die die Zusammenstellung von Fallakten ändern müssten, sind dieselben Menschen, die von der gegenwärtigen Praxis profitieren.

Was ich in meiner eigenen Arbeit getan habe, ist, den Code, den ich verwende, selbst zu schreiben. Ich vertraue kommerziellen Werkzeugen nicht, die ich nicht inspizieren kann. Ich muss die Daten sehen, das Signal hören, die Ausgabe auf der Ebene ihrer technischen Erzeugung verstehen, weil die Alternative darin bestünde, einem Algorithmus zu vertrauen, dessen Annahmen ich nicht prüfen und dessen Bias ich nicht sehen kann.

Was das Justizsystem den Menschen schuldet, die es verarbeitet

Kein Justizsystem ist neutral. Alle werden von Menschen betrieben, die in ihre Arbeit den vollständigen Apparat menschlicher Kognition mitbringen, einschließlich Biases, die weder Training noch Erfahrung beseitigt. Das ist kein Rat zur Resignation, sondern eine Beschreibung der tatsächlichen Situation, von der aus jede ehrliche Reform ausgehen muss. Die Frage ist nicht, wie eine vollständige Objektivität erreicht werden kann, die die kognitionswissenschaftliche Literatur als nicht erreichbar erwiesen hat. Die Frage ist, wie prozedurale Strukturen gebaut werden können, die den Einfluss von Bias einschränken, anstatt ihn zu verstärken.

Die Einschränkungen existieren. Sie wurden über drei Jahrzehnte dokumentiert, getestet, verfeinert und in referierten Fachzeitschriften veröffentlicht. Die National Academy of Sciences hat sie 2009 benannt. Der Präsidentschaftsrat für Wissenschaft und Technologie hat sie 2016 erneut formuliert. Sie sind weder geheim noch teuer noch technisch unzugänglich. Sie sitzen in der veröffentlichten Literatur und warten auf ein System, das bereit ist, sich an den Beweisen zu orientieren, auf die es sich zu stützen behauptet.

Gerichte rufen immer wieder dieselben Sachverständigen. Die weißen Listen sind real, auch wo sie ungeschrieben sind. Die schwarzen Listen sind real, auch wo das Wort nie ausgesprochen wird. Der Sachverständige, der unbequeme Befunde berichtet, erntet institutionelle Konsequenzen, die ohne Erklärung geliefert und ohne Rechtsmittel gespürt werden. Das ist kein Problem am Rand des Systems, es ist ein Merkmal seiner Mitte, und die Menschen, die dafür zahlen, sind nicht die Sachverständigen, die Staatsanwälte oder die Richter. Es sind diejenigen auf der Anklagebank, die annahmen, dass die Person, die über sie aussagt, die Beweise als Wissenschaftlerin geprüft hat und nicht als Verbündete.

Objektivität ist keine professionelle Eigenschaft. Sie kommt nicht mit einem Akkreditierungsschein, einem Titel oder einem Laborkittel. Sie ist eine Praxis, eine, die aktiv gegen den konstanten Druck von Kontext, Erwartung, institutioneller Loyalität und dem sehr menschlichen Verlangen aufrechterhalten werden muss, als sicher statt als ehrlich zu gelten. Wenn sie aufgehört hat, praktiziert zu werden, produziert der Schaden nicht immer einen Freispruch, über den die Presse berichtet. Meistens produziert er einfach eine Verurteilung, und die Person, die sie verbüßt, hat keine Möglichkeit zu wissen, dass die Zuversicht, die in der Aussage gegen sie gezeigt wurde, eine Vorstellung war, die die Beweise nicht tragen konnten.

Das Justizsystem kann besser sein als das. Die Wissenschaft, die es besser machen würde, existiert. Die Entscheidung, diese Wissenschaft nicht zu nutzen, wird jeden Tag von denselben Institutionen getroffen, die ihre Autorität damit rechtfertigen, dass die Wissenschaft auf ihrer Seite steht.

Quellen

- Dror, I. E., Charlton, D. und Peron, A. (2006). Contextual information renders experts vulnerable to making erroneous identifications. Forensic Science International, 156(1), 74-78.

- Dror, I. E. und Charlton, D. (2006). Why experts make errors. Journal of Forensic Identification, 56(4), 600-616.

- Dror, I. E. und Hampikian, G. (2011). Subjectivity and bias in forensic DNA mixture interpretation. Science and Justice, 51(4), 204-208.

- Dror, I. E. (2020). Cognitive and human factors in expert decision making: Six fallacies and the eight sources of bias. Analytical Chemistry, 92(12), 7998-8004.

- FBI (2015). FBI testimony on microscopic hair analysis contained errors in at least 90 percent of cases in ongoing review. Pressemitteilung, 20. April 2015.

- Innocence Project (2023). Not a strand of evidence: Cases involving microscopic hair comparison analysis.

- Kahneman, D. (2011). Thinking, Fast and Slow. Farrar, Straus and Giroux.

- National Research Council, National Academy of Sciences (2009). Strengthening Forensic Science in the United States: A Path Forward. National Academies Press.

- Office of the Inspector General, U.S. Department of Justice (2006). A Review of the FBI’s Handling of the Brandon Mayfield Case. Oversight and Review Division.

- President’s Council of Advisors on Science and Technology (2016). Forensic Science in Criminal Courts: Ensuring Scientific Validity of Feature-Comparison Methods. Executive Office of the President.

- Risinger, D. M., Saks, M. J., Thompson, W. C. und Rosenthal, R. (2002). The Daubert/Kumho implications of observer effects in forensic science. University of Chicago Law Review, 69(1), 1-56.