DeepSeek und das Prinzip des kostenlosen Mittagessens

Über die Behauptung, ein chinesisches Startup habe ein KI-Modell für 6 Millionen Dollar trainiert, die ClickHouse-Datenbank, die ohne jeden Authentifizierungsanspruch öffentlich im Internet stand, was es bedeutet, interne Daten einem System zu übergeben, das gesetzlich verpflichtet ist, sie auf Anfrage mit dem chinesischen Staat zu teilen, und die Frage, warum der Aktienmarkt offenbar einen Datenbankskandal und ein italienisches Verbot brauchte, um etwas zu bemerken, das Chinas Nationalsicherheitsgesetz seit 2017 ausdrücklich festlegt.

Dieser Beitrag wurde am 5. Mai 2026 grundlegend überarbeitet. Da sich dieses Thema schnell weiterentwickelt, sind Ungenauigkeiten nicht vollständig auszuschließen.

Am 27. Januar 2025 verlor Nvidia ungefähr 590 Milliarden Dollar an Marktkapitalisierung in einer einzigen Handelssitzung. Der unmittelbare Auslöser war die Veröffentlichung eines technischen Berichts und die Markteinführung einer Consumer-App eines Startups aus Hangzhou, China, das behauptete, sein KI-Modell erbinge vergleichbare Leistungen zu den besten verfügbaren westlichen Systemen, habe aber einen Bruchteil so viel in der Entwicklung gekostet. Die Behauptung war spektakulär genug, dass professionelle Anleger, die dafür bezahlt werden, Behauptungen zu prüfen, bevor sie auf sie reagieren, die Aktien jedes KI-angrenzenden Unternehmens verkauften, das sie identifizieren konnten, bevor irgendjemand die Behauptung auch nur einer elementaren Prüfung unterzogen hatte. Was ungewöhnlich war, ist, dass sich die Behauptung teilweise als wahr, teilweise als irreführend und vollständig als am wichtigsten irrelevant herausstellte.

Die wichtigste Frage, die DeepSeek aufwarf, war nie die der Trainingskosten. Sie lautet: Was geschieht mit den Informationen, die man einem KI-System schickt, das von einem chinesischen Technologieunternehmen unter der Rechtszuständigkeit der Volksrepublik China betrieben wird?

Die technischen Behauptungen und was sie tatsächlich bedeuten

DeepSeek-V3, das Basismodell, auf dem das R1-Reasoning-System aufgebaut ist, ist eine Mixture-of-Experts-Architektur mit insgesamt 671 Milliarden Parametern, von denen 37 Milliarden für jeden Inferenzdurchgang aktiviert werden (DeepSeek-AI, 2024, “DeepSeek-V3 Technical Report”, arXiv:2412.19437). Die MoE-Konstruktion ist keine DeepSeek-Erfindung; es ist eine etablierte Architektur, die einem großen Modell erlaubt, verschiedene Anfragen an verschiedene Teilmengen seiner Parameter weiterzuleiten, was den Rechenaufwand pro Inferenz reduziert. Der eigentliche Ingenieurleistungsanspruch in V3 lag in der Effizienz der Implementierung: Das Modell wurde auf 14,8 Billionen Token mit 2,788 Millionen H800-GPU-Stunden trainiert, was bei DeepSeeks eigenem Ansatz von 2 Dollar pro GPU-Stunde Trainingskosten von ungefähr 5,58 Millionen Dollar ergibt.

Diese Zahl schuf die Erzählung. Das GPT-4-Training von OpenAI wird allgemein auf über 100 Millionen Dollar geschätzt; ein chinesisches Startup hatte offenbar ein vergleichbares Modell zu etwa 5 Prozent dieser Kosten produziert. Die Wall Street interpretierte das als Beweis, dass die massiven GPU-Infrastrukturinvestitionen der größten Nvidia-Kunden wirtschaftlich unnötig waren, weshalb Nvidias Aktienkurs in einem Nachmittag 590 Milliarden Dollar verlor.

Die folgende Überprüfung war aufschlussreich. SemiAnalysis, ein unabhängiges Halbleiter- und KI-Forschungsunternehmen mit dokumentierten Quellen im chinesischen Technologiesektor, schätzte, dass DeepSeeks gesamte Serverinvestitionen, einschließlich eines Inventars von ungefähr 50.000 Nvidia-Hopper-GPUs, auf ungefähr 1,3 Milliarden Dollar beliefen. Die 5,58 Millionen Dollar repräsentierten nur die GPU-Stunden, die in der Vortrainingsphase berechnet wurden, und schlossen Forschungs- und Entwicklungskosten, Mitarbeiter, Infrastruktur-Overhead und den erheblichen explorativen Rechenaufwand für Ansätze, die nicht funktionierten, vollständig aus.

Als DeepSeek anschließend ein Papier in Nature veröffentlichte, das zusätzliche Details über R1 enthüllte, erkannte das Dokument an, dass das Modell auf dem V3-Basismodell beruhte, dass die häufig zitierten 294.000 Dollar Trainingskosten ausschließlich die Reinforcement-Learning-Phase betrafen, und dass die Trainingsdaten für V3 “eine erhebliche Anzahl” von OpenAI-generierten Antworten enthielten. Microsoft hatte Wochen vor diesen Offenlegungen eine verdeckte Untersuchung wegen möglichem Distillation Theft eingeleitet.

Das bedeutet nicht, dass DeepSeek technisch unbeeindruckend ist. Es ist beeindruckend. Die MoE-Architektur, das Multi-head Latent Attention-Design und die GRPO-Verstärkungslerntechnik repräsentieren echte Ingenieurarbeit, und die Benchmark-Leistung von R1 in AIME-Mathematik und MMLU-Allgemeinwissen entspricht oder nähert sich den besten verfügbaren westlichen Modellen zu einem API-Preis von 2,19 Dollar pro Million Token im Vergleich zu OpenAI o1s 60 Dollar, ein Unterschied von ungefähr dem 27-Fachen (HiddenLayer Security, 2025). Die Kosteneffizienz ist real. Die Behauptung, sie sei bei 6 Millionen Dollar insgesamt erreicht worden, ist es nicht.

Die Trainingsdaten-Kontroverse: Wessen Wissen steckt da eigentlich drin?

Neben der Kostenfrage gibt es eine zweite Kontroverse rund um DeepSeek, die erheblich weniger Aufmerksamkeit erhalten hat: die Frage, aus welchen Quellen das Modell trainiert wurde. DeepSeek gab in seiner Nature-Veröffentlichung zu, dass die Trainingsdaten für V3 eine “erhebliche Anzahl” von Antworten enthielten, die von OpenAI-Systemen generiert worden waren. OpenAI und Microsoft begannen unabhängig voneinander Untersuchungen wegen potenziellem Distillation Theft. Die rechtliche Situation ist ungeklärt, was in der Praxis bedeutet, dass derzeit niemand mit Sicherheit sagen kann, wessen Wissen eigentlich im DeepSeek-R1-Modell steckt. Ein destilliertes Modell erbt nicht nur das Wissen seines Lehrers, sondern auch dessen Blindstellen. Das ist für jeden relevant, der DeepSeek für Aufgaben einsetzt, bei denen Verlässlichkeit und Unabhängigkeit des Modellurteils wichtig sind.

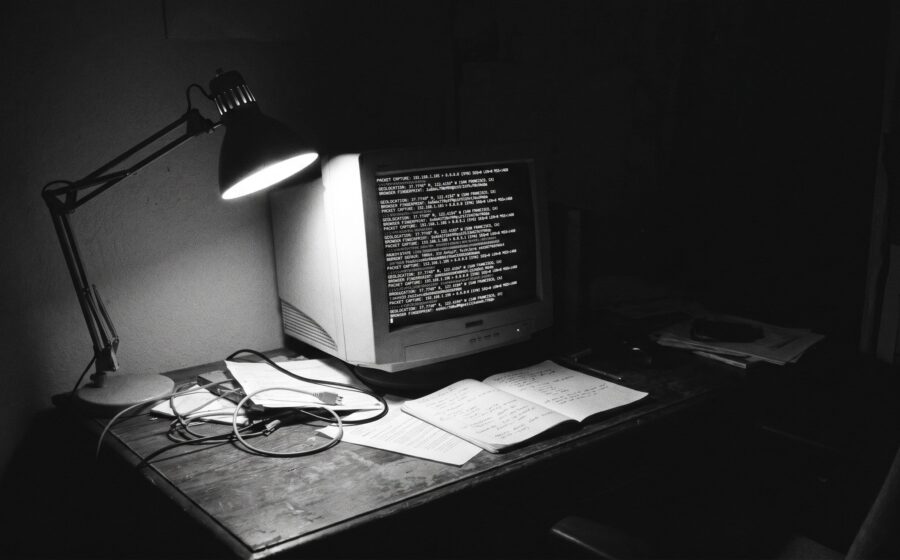

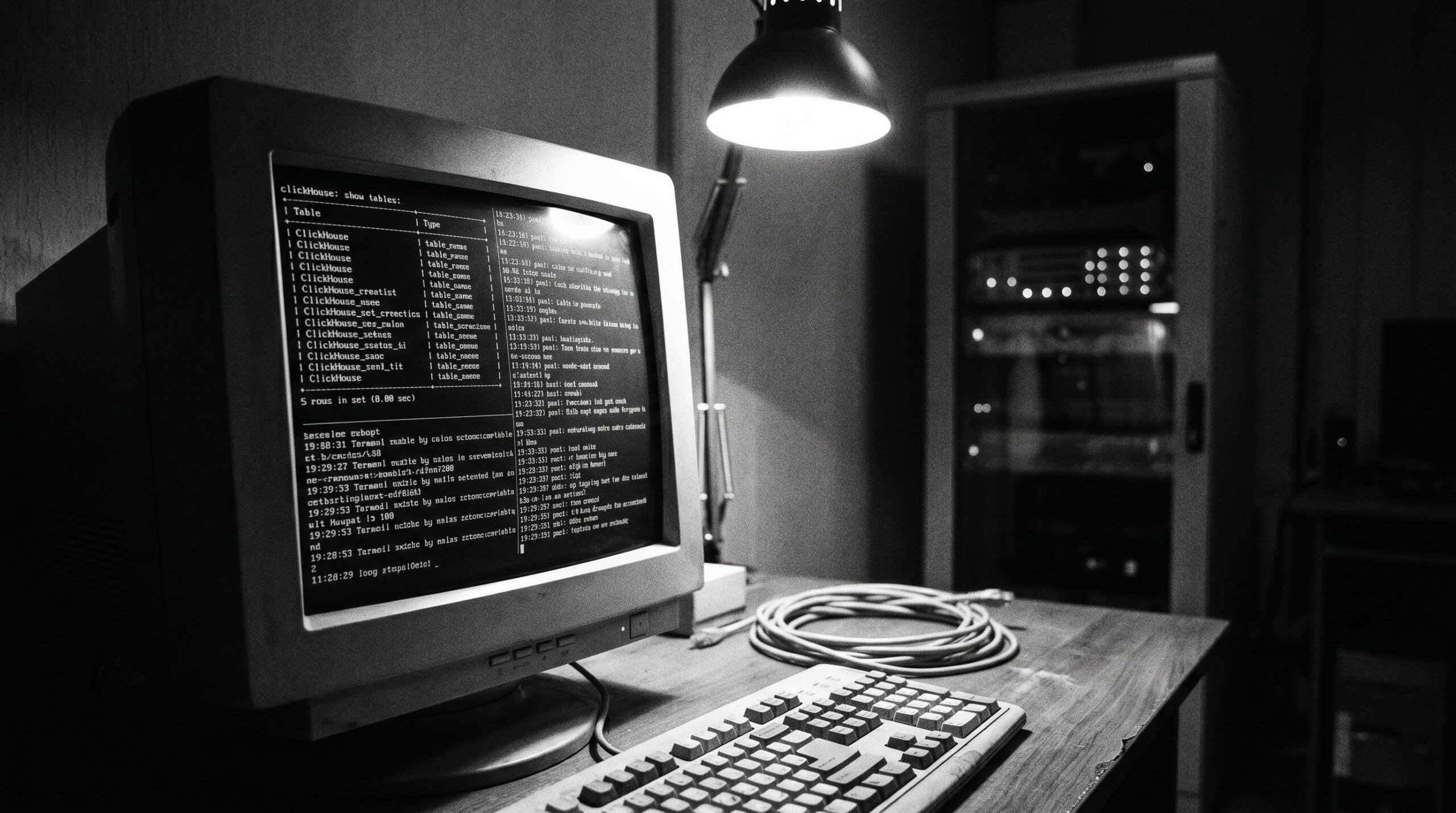

Die Datenbank, die ohne Passwort offen stand

Während die Benchmark-Debatten die Technologiepresse beschäftigten, entdeckte Wiz Research, ein Cloud-Sicherheitsunternehmen, etwas erheblich Konkreteres. Eine ClickHouse-Datenbank von DeepSeek war ohne jede Authentifizierungsanforderung öffentlich im Internet zugänglich. Die Datenbank enthielt über 1 Million Protokolleinträge, einschließlich Klartext-Chat-Verläufen, API-Schlüsseln, Backend-Systemdetails und Betriebsmetadaten. Wie Wiz Researchs Analyst Gal Nagli die Exposition beschrieb, war sie “tiefhängende Frucht für Angreifer”, was bedeutet, dass sie keine Ausnutzungstechnik, keine Schwachstellenforschung und keine besondere Fähigkeit erforderte.

Die Forscher, die die Exposition entdeckten, versuchten, DeepSeek über die offiziellen Kanäle zu kontaktieren: eine dedizierte Sicherheits-E-Mail, ein Bug-Bounty-Programm, einen dokumentierten Ansprechpartner für Schwachstellenberichte. DeepSeek hatte keines davon. Die Forscher sandten Nachrichten an E-Mail-Adressen und LinkedIn-Profile, die sie ausfindig machen konnten. Sie erhielten keine Bestätigung. Innerhalb von etwa 30 Minuten nach ihrer Kontaktaufnahme wurde die Datenbank gesichert. Ob sie vorher von Parteien mit weniger gutartigen Absichten aufgerufen worden war, hat DeepSeek nie bestätigt.

Ein Unternehmen, das einen KI-Chat-Dienst mit Dutzenden von Millionen Nutzern betreibt, hatte eine Produktionsdatenbank mit 1 Million Protokolleinträgen öffentlich zugänglich ohne Authentifizierung stehen lassen. Als die Exposition entdeckt wurde, hatte das Unternehmen keinen dokumentierten Sicherheitsansprechpartner. Als eine Benachrichtigung gesendet wurde, bestand die Reaktion darin, die Exposition still zu schließen, ohne sie anzuerkennen. Das ist keine Sicherheitsposition; es ist das Fehlen einer solchen.

Die Datenschutzarchitektur, die von Anfang an das Problem war

Die exponierte Datenbank war ein folgenreicher Vorfall, aber nicht die strukturell bedeutendste Datenschutzfrage im Zusammenhang mit DeepSeek. Das grundlegendere Problem war vor dem Datenbankverstoß sichtbar und hängt überhaupt nicht von einem Sicherheitsversagen ab.

DeepSeeks Datenschutzrichtlinie gibt an, dass Benutzerdaten auf Servern gespeichert werden, die sich in der Volksrepublik China befinden. Sicherheitsforscher bei NowSecure entdeckten anschließend, dass DeepSeeks iOS-Anwendung mit Volcengine kommuniziert, der Cloud-Infrastrukturplattform von ByteDance, derselben Mutterorganisation wie TikTok.

Diese Fakten sind hauptsächlich bedeutsam wegen dem, was chinesisches Recht über sie sagt. Chinas Nationales Geheimdienstgesetz von 2017 legt in Artikel 7 fest, dass “alle Organisationen und Bürger nationale Geheimdienstarbeit nach dem Gesetz unterstützen, assistieren und kooperieren sollen.” Artikel 12 gewährt Geheimdienstbehörden die Befugnis, die Zusammenarbeit bei Geheimdienstaufgaben von jeder relevanten Organisation oder Person zu verlangen. Das Gesetz sieht keinen Justizkontrollmechanismus vor, der einem Gerichtsbeschluss in westlichen Rechtssystemen entspricht, noch enthält es Bestimmungen, die einem Unternehmen erlauben würden, eine staatliche Anfrage auf der Grundlage der Mandantenvertraulichkeit abzulehnen.

Diese Rechtsstruktur bedeutet, dass alle in China gespeicherten und von einem chinesischen Unternehmen gehaltenen Daten nach dem Gesetz für chinesische Staatsnachrichtendienste auf Anfrage zugänglich sind, ohne Kenntnis oder Zustimmung des Betroffenen und ohne Rechtsbehelf. Das ist keine Spekulation über DeepSeeks Absichten. Es ist eine Beschreibung des rechtlichen Rahmens, in dem DeepSeek operiert. Für Unternehmen, die proprietäre Anfragen, interne Dokumente oder Geschäftsstrategien einem cloudbasierten KI-System unter diesem Rechtsrahmen anvertrauen, ist die Exposition nicht ungewiss. Sie ist sicher.

Der amerikanische Spiegel

Ich erwähne einen Aspekt, den ich für unehrlich halten würde auszulassen: US-amerikanische KI-Dienste operieren unter einem anderen, aber analog komplexen Rechtsrahmen. Die Erhebungsbefugnisse der NSA nach Abschnitt 702 des Foreign Intelligence Surveillance Act, die National Security Letter-Regelungen des USA PATRIOT Act und die CLOUD Act-Mechanismen für staatlichen Datenzugang repräsentieren rechtlich autorisierte Datenzugriffe ohne individuelle Benachrichtigung. Die bedeutsamen Unterschiede zwischen dem US-amerikanischen und dem chinesischen Rechtsrahmen liegen in der Verfügbarkeit von Justizkontrolle, der Existenz von Aufsichtsmechanismen mit tatsächlichem Rechtsstand und dem dokumentierten Durchsetzungsprotokoll gegen unbefugten Zugriff. Diese Unterschiede sind real und bedeutsam. Sie eliminieren nicht die zugrundeliegende strukturelle Realität, dass cloudbasierte KI-Dienste in jeder Jurisdiktion in keinem absoluten Sinne privat sind. Der Unterschied zu China liegt nicht im Ob, sondern im Wie: im Verfahrensrecht, das den Zugriff reguliert, und in den Konsequenzen, die drohen, wenn diese Regulierung verletzt wird.

Italiens Datenschutzbehörde, Südkorea und die Regulierungsantwort

Mehrere Datenschutzbehörden reagierten rasch. Der Garante, die italienische Datenschutzbehörde, erließ am 30. Januar 2025 eine Entscheidung, die DeepSeek in der Europäischen Union blockierte, mit der Begründung, DeepSeeks Reaktion auf seine Datenanfrage sei “vollständig unzureichend”, und stellte fest, dass DeepSeek nicht nachgewiesen hatte, die Anforderungen der DSGVO bezüglich Datensparsamkeit, Zweckbindung und Schutzmaßnahmen für grenzüberschreitende Transfers zu erfüllen. Unter der DSGVO erfordert die Übermittlung personenbezogener Daten in ein Drittland entweder einen Angemessenheitsbeschluss, angemessene Schutzmaßnahmen oder eine der engen Ausnahmen in Artikel 49. Für China existiert kein Angemessenheitsbeschluss.

Südkoreas Persönliche-Daten-Schutzkommission leitete gleichfalls eine Untersuchung ein. Irlands Datenschutzkommission eröffnete eine Voruntersuchung. Für europäische Unternehmen, die DeepSeek im beruflichen Kontext einsetzen, stellt das DSGVO-Konformitätsproblem einen eigenständigen Haftungsaspekt dar, der vollständig unabhängig von der Frage besteht, ob chinesische Geheimdienste an ihren spezifischen Daten interessiert sind.

Das Open-Source-Modell und seine tatsächlichen Sicherheitsimplikationen

Eine Antwort auf die Cloud-Datenschutzbedenken ist die lokale Ausführung von DeepSeek mit den auf HuggingFace veröffentlichten Open-Source-Gewichten. Das Modell ist genuinerweise für die lokale Bereitstellung verfügbar, und das Ausführen von Inferenzen auf eigener Hardware eliminiert das Problem der grenzüberschreitenden Datenübermittlung vollständig. Das ist eine legitime Option und aus der Perspektive der Datensouveränität die richtige für jede Organisation, die ihre Informationssicherheit ernst nimmt.

Es ist jedoch keine einfache Option. Das vollständige Modell mit 671 Milliarden Parametern erfordert mehrere High-End-GPUs mit erheblichem VRAM, und während destillierte Varianten von 7 bis 70 Milliarden Parametern auf zugänglicherer Hardware laufen können, weicht die Inferenzerfahrung erheblich von der Frontier-Fähigkeit ab, die die Benchmark-Ergebnisse erzeugte.

HiddenLayer Security identifizierte auch ein technisches Problem spezifisch für die lokale Bereitstellung von DeepSeeks Open-Weight-Modellen: Die Modellkonfiguration erfordert, dass das Flag trust_remote_code=True gesetzt wird, das die Ausführung von beliebigem Python-Code aus dem Modell-Repository erlaubt. Dieses Flag ist eine Standardsicherheitswarnung in der Machine-Learning-Engineering-Community. Zusätzlich fand das Red-Teaming von HiddenLayer DeepSeek R1 anfälliger als vergleichbare Modelle für Jailbreak-Techniken, Prompt-Injection und die Ausnutzung von Steuer-Token.

Was Unternehmen und Fachleute tun sollten

Die praktische Situation für ein Unternehmen, das KI-Tools in Betracht zieht, ist folgende: Jeder cloudbasierte KI-Dienst überträgt Anfragen an die Server des betreibenden Unternehmens und verarbeitet sie gemäß dessen Datenschutzrichtlinie und rechtlichem Rahmen. Für Dienste, die unter DSGVO-adäquaten Rechtsrahmen betrieben werden, bedeutet das rechtliche Schutzanforderungen mit sinnvollen Durchsetzungsmechanismen. Für Dienste in Jurisdiktionen ohne gleichwertige Datenschutzgesetze, einschließlich China, sind die rechtlichen Schutzmaßnahmen qualitativ anders und aus DSGVO-Sicht nicht ausreichend.

Für Fachleute oder Organisationen, die kommerziell sensible oder regulierte Informationen verarbeiten, erfordert die Nutzung eines cloudbasierten KI-Dienstes die Bewertung des anwendbaren Rechts. Bei Daten von wesentlicher Sensitivität lautet die korrekte Antwort immer ein Bereitstellungsmodell, bei dem die Daten die selbst kontrollierte Infrastruktur nicht verlassen.

Der technische Unterschied zwischen der Nutzung eines API-Schlüssels und der Ausführung eines Sprachmodells auf eigener Hardware ist der Unterschied zwischen dem Senden aller Abfragen an einen externen Empfänger und dem Ausführen der Inferenz auf Maschinen, auf die ausschließlich eigenes Personal zugreift. Ein API-Schlüssel ist kein Datenschutzmechanismus; er ist eine Abrechnungsanforderung. Die Daten verlassen trotzdem das Unternehmen. Auf meiner eigenen Infrastruktur laufen die KI-Dienste, die ich betreibe, einschließlich des Tyra-Systems, auf kontrollierter Hardware mit Daten, die keine Drittanbieter-Cloud-Infrastruktur passieren. Das ist kein technisch exotisches Arrangement; es ist der Standard, den die Informationssicherheitspraxis für sensible Datenverarbeitung empfiehlt.

Was ein KI-Chat-System tatsächlich überträgt

Es lohnt sich, konkret zu beschreiben, was ein cloudbasierter KI-Chat-Dienst über das Offensichtliche hinaus erfasst. Der Inhalt einer Anfrage ist das Sichtbarste, aber nicht das Einzige. Jede Interaktion mit einem cloudbasierten KI-System erzeugt Metadaten: Zeitpunkt der Anfrage, Dauer der Sitzung, Geräteinformationen, IP-Adresse und damit geographische Position, Nutzerkennung und die sequenzielle Abfolge von Anfragen innerhalb einer Sitzung und über Sitzungen hinweg. Aus dieser Sequenz lassen sich Schlüsse ziehen, die weit über den Wortlaut einzelner Nachrichten hinausgehen.

Wer täglich um 8:30 Uhr eine KI nach Marktinformationen zu einem bestimmten Sektor befragt, täglich um 10:00 Uhr nach internen Kommunikationsstrategien und gelegentlich nach der Formulierung von Schreiben an bestimmte Behörden, hat ein Nutzungsprofil erzeugt, das deutliche Rückschlüsse auf Unternehmensstrategie und Wettbewerbsinteressen erlaubt, auch wenn kein einzelner Prompt explizit sensible Informationen enthält. KI-Systeme sind für diese Art der Profilierung besonders gut geeignet, weil Menschen ihnen gegenüber anders kommunizieren als gegenüber Suchmaschinen: vollständiger, konzeptueller, kontextreicher, und mit einem Grad der gedanklichen Offenheit, den man wählt, weil man glaubt, niemand lese mit.

Die Illusion, nichts wirklich Sensibles in einen KI-Chat einzutippen, ist eine der wirkungsvollsten Selbsttäuschungen, die die Datenschutzdiskussion der letzten Jahre produziert hat. Ein KI-Chat-System akkumuliert diese Information nicht als Stichwortliste, sondern als semantisch kohärentes Gesprächsarchiv, das einem ausgebildeten Analysten erheblich mehr über den Nutzer verrät als dieser zu haben geglaubt hätte.

Polemische Vorwarnung

Ich möchte direkt über das sein, was der DeepSeek-Moment über seine spezifischen technischen und rechtlichen Einzelheiten hinaus illustrierte. Die 590 Milliarden Dollar Verlust bei Nvidias Marktkapitalisierung wurden von Investoren angetrieben, die auf die Schlagzeile reagierten, bevor irgendjemand die Behauptung geprüft hatte, und die anschließend zusahen, wie diese Behauptung erheblich revidiert wurde, ohne die 590 Milliarden zurückzubekommen.

Die KI-Branche im Allgemeinen und der öffentliche Diskurs über KI im Besonderen haben eine etablierte Praxis, spezifische Fähigkeiten als allgemeine Fähigkeiten zu präsentieren, spezifische Trainingskostenangaben als umfassende Kostenangaben und Benchmark-Leistung als reale Leistung. DeepSeek tat das mit seiner Trainingskostenerzählung. OpenAI tut es mit Fähigkeitsbehauptungen. Die spezifische Form der Behauptung ändert sich; die Struktur, die darin besteht, eine günstige Metrik als die repräsentative Metrik zu präsentieren, nicht. Die repräsentative Metrik für DeepSeek ist nicht die Trainingskosten. Sie ist die Rechtszuständigkeit.

Schlusswort

Das Prinzip des kostenlosen Mittagessens in der Wirtschaft besagt, dass wenn etwas keine Kosten zu haben scheint, man wahrscheinlich nicht alle Kosten sieht. DeepSeeks KI-Fähigkeiten sind beeindruckend, und die Ingenieurarbeit dahinter ist real. Die Kosten dieser Fähigkeiten für einen Nutzer, der seine Anfragen an DeepSeeks Server schickt, werden nicht in Dollar denominiert. Sie werden in den in diesen Anfragen enthaltenen Informationen denominiert, die in einer Jurisdiktion gespeichert sind, deren Gesetz verlangt, dass sie auf Anfrage für staatliche Nachrichtendienste verfügbar gemacht werden, ohne Benachrichtigung des Nutzers, ohne Justizkontrolle und ohne praktischen Widerspruchsmechanismus.

Ich betreibe meine eigenen KI-Dienste auf kontrollierter Hardware. Nicht weil ich ein pathologisches Misstrauen gegenüber Technologieunternehmen habe, sondern weil die Alternative, nämlich vertrauliche Arbeitsvorgänge durch eine Cloud zu routen, deren Betreiber man nicht kennt und deren Rechtszuständigkeit man nicht kontrolliert, das genaue Gegenteil von dem ist, was ich meinen Klienten empfehlen würde. Ich halte es für konsistent, das auch selbst zu praktizieren.

Das ist der Preis. Ob er akzeptabel ist, hängt davon ab, was man in die Anfrage eintippt, und von der eigenen Einschätzung, wen diese Informationen interessieren könnten. Jeder, der einen KI-Chat-Dienst so nutzt, wie er genutzt werden soll, nämlich um durch komplexe Probleme zu arbeiten, sensible Kommunikation zu entwerfen, proprietäre Daten zu analysieren und das volle Spektrum des eigenen Denkens ohne Selbstzensur zu erkunden, sollte auf diese Frage eine klare Antwort haben, bevor er entscheidet, welche Cloud die Ausgabe empfängt.

Quellen

- Axis Intelligence. (2026). Is DeepSeek safe 2026? Security concerns and honest assessment. https://axis-intelligence.com/is-deepseek-safe-2026-security-concerns/

- DeepSeek-AI. (2024). DeepSeek-V3 Technical Report. arXiv:2412.19437.

- Garante per la protezione dei dati personali. (2025). Decisione di blocco DeepSeek, 30. Januar 2025.

- HiddenLayer Security. (2025). Exposing the security risks of DeepSeek-R1. https://hiddenlayer.com

- SemiAnalysis. (2025). DeepSeek infrastructure cost and GPU inventory analysis. SemiAnalysis Research.

- TechSpot. (2025). DeepSeek R1 training cost disclosures. https://www.techspot.com/news/109542

- The Register. (2025). DeepSeek didn’t really train its flagship model for 4,000. https://www.theregister.com/2025/09/19/deepseek_cost_train

- Volksrepublik China. (2017). Nationales Geheimdienstgesetz, Artikel 7 und 12. Ständiger Ausschuss des Nationalen Volkskongresses.

- Wiz Research / Nagli, G. (2025). DeepSeek ClickHouse database exposure. Wiz Research.